Le référencement naturel (SEO) n'est plus seulement une affaire de contenu ou de netlinking. En 2026, face à la complexité des algorithmes de Google et à l'émergence des moteurs de recherche par Intelligence Artificielle (AIO), le SEO est devenu une discipline d'ingénierie à part entière.

Les moteurs d’IA comme ChatGPT Search ou Perplexity privilégient des pages immédiatement interprétables : HTML sémantique, données structurées et contenu accessible sans exécution JavaScript complexe. La meilleure stratégie éditoriale du monde ne produira aucun retour sur investissement si l'architecture sous-jacente de votre site web empêche ces robots d'explorer, de comprendre et d'indexer vos pages correctement.

Chez KOLCHY, nous auditons régulièrement des plateformes qui perdent des milliers de visites mensuelles non pas à cause de leurs concurrents, mais à cause de leur propre dette technique front-end ou back-end.

Voici les 5 erreurs d'ingénierie web les plus fréquentes (et les plus coûteuses) que nous rencontrons, et les solutions architecturales pour les corriger.

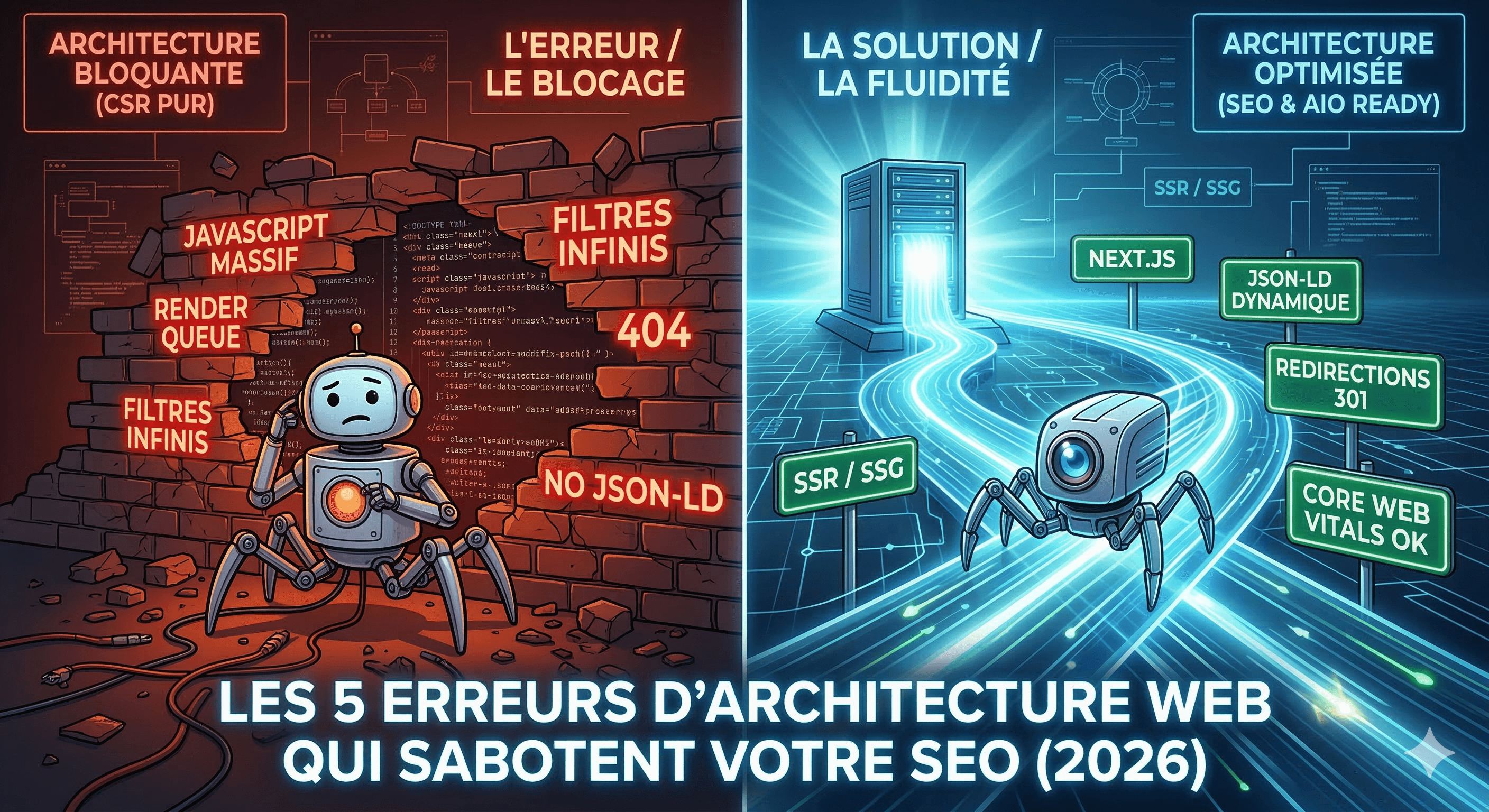

Erreur n°1 : Le Client-Side Rendering (CSR) exclusif sans stratégie d'indexation

C’est le piège classique des architectures modernes. Une équipe de développement choisit une excellente librairie comme React ou Vue.js pour créer une application web ultra-réactive. Le problème ? Ils déploient l'application en mode Client-Side Rendering (CSR) pur.

Pourquoi c'est un désastre SEO : Dans une architecture CSR, le serveur envoie au navigateur un fichier HTML pratiquement vide (contenant souvent juste une balise <div id="root"></div>) accompagné d'un lourd fichier JavaScript. C'est le navigateur de l'utilisateur qui exécute ce code pour construire l'interface et afficher le texte. Les robots d'indexation (Googlebot) n'ont ni le temps, ni les ressources de calcul pour exécuter systématiquement ce JavaScript. Votre contenu est donc placé dans une "Render Queue" (file d'attente de rendu), retardant son indexation de plusieurs jours. Lors de nos audits techniques, nous observons d'ailleurs régulièrement des pages React dont le code HTML initial pèse moins de 2 KB et ne contient absolument aucun texte indexable avant l’exécution complète du bundle JavaScript. Pire encore, face à un CSR pur, les nouveaux crawlers d'IA voient souvent une simple page blanche.

La solution technique :

- Adopter le rendu hybride : Migrer vers un framework Full-Stack comme Next.js (pour React) ou Nuxt.js (pour Vue). (Découvrez notre analyse complète : Pourquoi Next.js s'impose pour le SEO [insérer lien interne vers l'article Next.js])

- Implémenter le SSR ou le SSG : Le Server-Side Rendering ou la Static Site Generation permettent de générer le code HTML côté serveur. Le robot reçoit un document sémantique immédiatement lisible, sans exécuter la moindre ligne de JS.

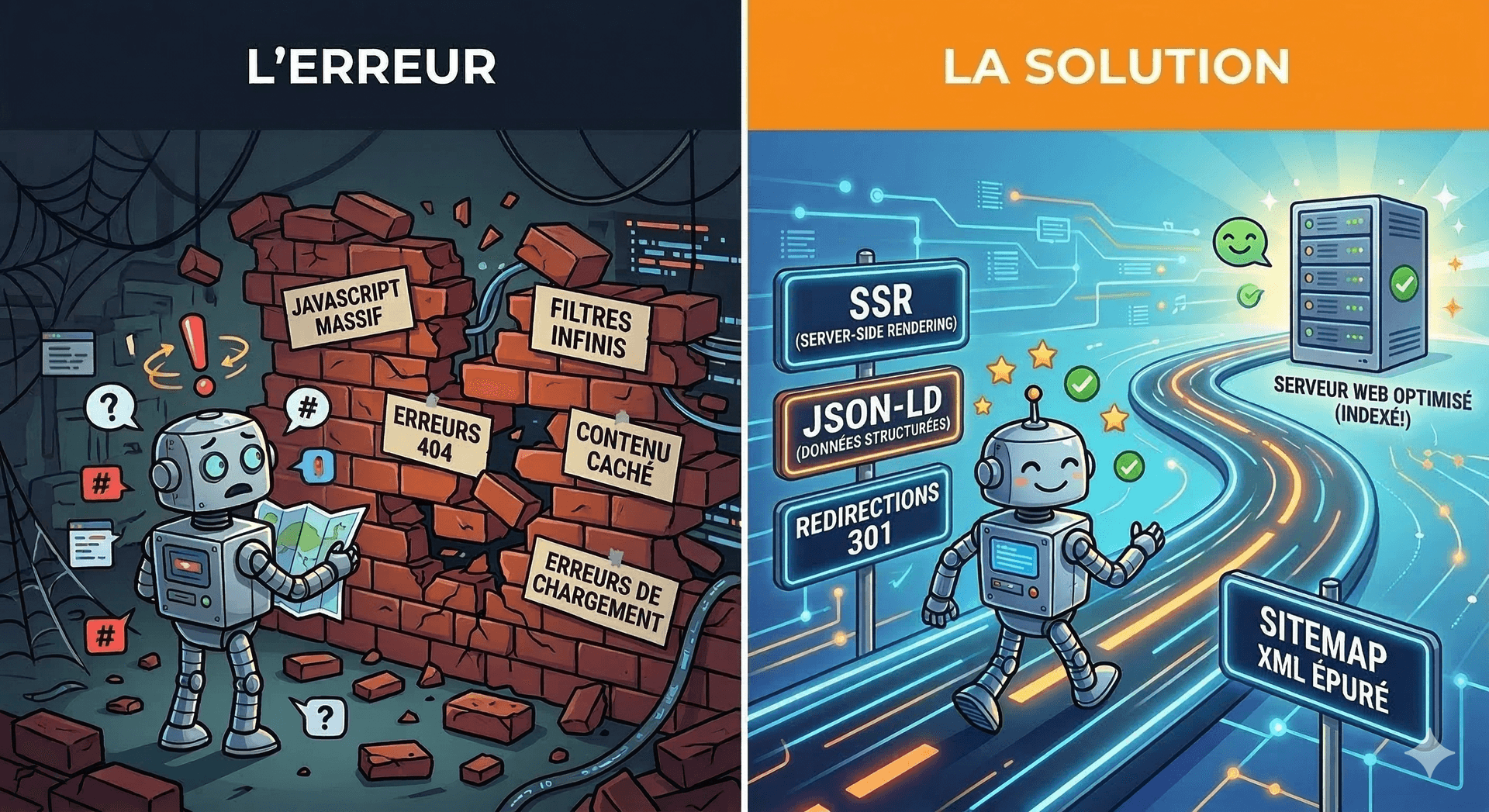

Erreur n°2 : Les "Spider Traps" générés par la navigation à facettes

Cette erreur concerne particulièrement les plateformes e-commerce et les annuaires complexes. Pour améliorer l'expérience utilisateur, les développeurs implémentent des filtres cumulables (Couleur, Taille, Marque, Prix, etc.).

Pourquoi c'est un désastre SEO : Si ces filtres génèrent de nouvelles URL dynamiques (?couleur=rouge&taille=M&tri=prix-croissant) sans restriction, vous créez un "Spider Trap" (piège à robots). Le moteur de recherche va tenter d'explorer toutes les combinaisons possibles (qui se comptent souvent en millions). Résultat : vous épuisez votre Crawl Budget (le temps alloué par Google pour explorer votre site). Googlebot perd son temps sur des URL sans intérêt SEO et ignore vos nouvelles fiches produits importantes.

La solution technique :

- L'attribut Canonical : S'assurer que chaque URL filtrée pointe sa balise

<link rel="canonical" href="..." />vers l'URL parent de la catégorie principale. - Le blocage via Robots.txt : Interdire explicitement l'exploration des paramètres de tri ou de filtres inutiles (ex:

Disallow: /*?tri=*). - Gestion des liens (Nofollow / PRG) : Utiliser le pattern PRG (Post-Redirect-Get) ou injecter les liens de filtres via du JavaScript non-crawlable pour éviter que les robots ne suivent ces chemins infinis.

Erreur n°3 : Négliger les Core Web Vitals dans l'architecture front-end

Depuis plusieurs années, les Core Web Vitals (LCP, CLS, INP) sont des signaux de classement officiels. De nombreuses équipes techniques voient encore la performance web comme un simple bonus UX, et intègrent des scripts tiers (analytics, chabots, pixels publicitaires) sans contrôle.

Pourquoi c'est un désastre SEO : Un bundle JavaScript trop lourd, des images non compressées ou des polices de caractères bloquantes retardent l'affichage du contenu principal (mauvais LCP). Des éléments qui se chargent de manière asynchrone sans espace réservé font sauter la mise en page (mauvais CLS). Google pénalise les sites qui offrent une expérience dégradée, particulièrement sur mobile.

La solution technique :

- Utiliser les frameworks modernes : Des solutions comme Next.js ou Nuxt permettent d’améliorer ces métriques nativement grâce au rendu serveur, au streaming HTML et à l’optimisation automatique des images.

- Maîtrise du Main Thread : Différer (via les attributs

deferouasync) le chargement des scripts non critiques pour libérer le fil principal du navigateur et garantir une interactivité immédiate (score INP). - Taille du Bundle : Mettre en place du Code Splitting (découpage du code) pour que l'utilisateur ne télécharge que le JavaScript strictement nécessaire à la page consultée.

Erreur n°4 : L'intégration manuelle ou absente des données structurées (JSON-LD)

Les données structurées permettent aux moteurs de recherche de comprendre le contexte exact d'une page (s'agit-il d'un article, d'un produit, d'une offre d'emploi, d'une FAQ ?). L'erreur fréquente est de laisser les équipes marketing tenter de les gérer manuellement via des plugins basiques, ou pire, de les ignorer totalement.

Pourquoi c'est un désastre SEO : Sans données structurées, vous vous privez des Rich Snippets (résultats enrichis) dans Google, comme les étoiles d'avis, le prix direct d'un produit ou les menus déroulants de FAQ. Cela diminue drastiquement votre Taux de Clic (CTR). Plus important encore, dans l'ère de l'AIO, ne pas structurer sémantiquement ses données revient à parler une langue étrangère aux LLMs qui cherchent des réponses formatées.

La solution technique :

- Génération programmatique : L'équipe de développement doit automatiser la génération des scripts JSON-LD. Par exemple, sur une fiche produit, le script doit se peupler dynamiquement avec les variables de la base de données (nom, prix, stock, note moyenne) directement dans le composant de la page.

- Validation stricte : Intégrer des tests automatisés (CI/CD) pour vérifier la validité du schéma JSON-LD avant chaque déploiement en production.

Erreur n°5 : Les migrations de refonte désastreuses (Le syndrome de l'URL cassée)

C'est l'erreur la plus coûteuse financièrement. Une entreprise décide de moderniser sa stack technique (par exemple, passer d'un vieux CMS monolithique à une architecture Headless). Le nouveau site est magnifique, ultra-rapide, mais le trafic organique s'effondre de 80% le lendemain de la mise en production.

Pourquoi c'est un désastre SEO : Lors d'une refonte, l'architecture des URL change très souvent. Si les développeurs "éteignent" l'ancien site sans rediriger les anciennes URL vers les nouvelles, Google trouve des milliers d'erreurs 404. Tout l'historique SEO, l'autorité de la page et les backlinks accumulés pendant des années sont détruits instantanément.

La solution technique :

- Mapping d'URL rigoureux : Avant même d'écrire une ligne de code du nouveau site, créer un fichier de correspondance exhaustif entre l'intégralité des anciennes URL et les futures URL.

- Redirections 301 côté serveur : Implémenter ces redirections permanentes (HTTP 301) au niveau du serveur (Nginx, Apache) ou du CDN (Edge computing) pour assurer une transition transparente pour les utilisateurs et les robots.

- Conserver l'arborescence : Dans la mesure du possible, éviter de modifier les URL qui génèrent déjà un fort trafic organique.

Checklist d'Audit Rapide pour les Tech Leads

Avant votre prochaine mise en production, assurez-vous de pouvoir cocher ces 5 points :

- [ ] Désactiver le JavaScript du navigateur : le contenu principal de la page reste-t-il lisible ?

- [ ] Explorer les filtres e-commerce : les URL générées par les tris comportent-elles une balise canonical vers la page mère ?

- [ ] Analyser le rapport CrUX (Chrome UX Report) : les scores LCP, CLS et INP sont-ils dans le vert sur les données réelles (mobile) ?

- [ ] Tester une page produit dans l'outil de résultats enrichis de Google : le JSON-LD est-il valide et généré dynamiquement ?

- [ ] Simuler une refonte : le plan de redirection 301 couvre-t-il 100% des URL de l'ancien sitemap générant du trafic ?

Conclusion

Le développement web et le référencement naturel ne peuvent plus opérer en silos.

Un site peut avoir le meilleur contenu du monde, le design le plus immersif et l'offre commerciale la plus agressive. Si son architecture empêche les robots de l'explorer correctement, ce contenu restera définitivement invisible.

Réparer ces erreurs structurelles nécessite l'intervention d'ingénieurs capables de comprendre à la fois les contraintes de performance front-end et les mécaniques algorithmiques des moteurs de recherche.

Vous prévoyez une refonte technologique ou suspectez votre architecture actuelle de pénaliser votre visibilité ? L'équipe de KOLCHY vous accompagne pour concevoir des plateformes robustes, performantes et SEO-friendly by design.

Contactez-nous pour un audit technique complet de votre infrastructure.